WAN 2.2 Animate: Move und Replace in einem Workspace

Lade ein Charakterbild und ein Referenzvideo hoch, wähle Move zum Animieren des Bildes oder Replace, um einen Charakter in die Szene zu setzen. WAN 2.2 Animate verwandelt dein Footage in hochauflösende Charaktervideos mit Motion Transfer, Lip-Sync und konsistenter Beleuchtung – ohne lokale GPU.

Was ist WAN 2.2 Animate?

Ein einheitliches KI-Modell für Charakteranimation und Austausch

WAN 2.2 Animate ist ein Video-zu-Video-Modell der WAN 2.2 Familie, das jedes Referenzvideo in einen Driver für Charakterbewegung, Gesichtsausdrücke und Timing verwandelt.

Was ist WAN 2.2 Animate?

WAN 2.2 Animate ist ein Video-zu-Video-Modell der WAN 2.2 Familie, das jedes Referenzvideo in einen Driver für Charakterbewegung, Gesichtsausdrücke und Timing verwandelt.

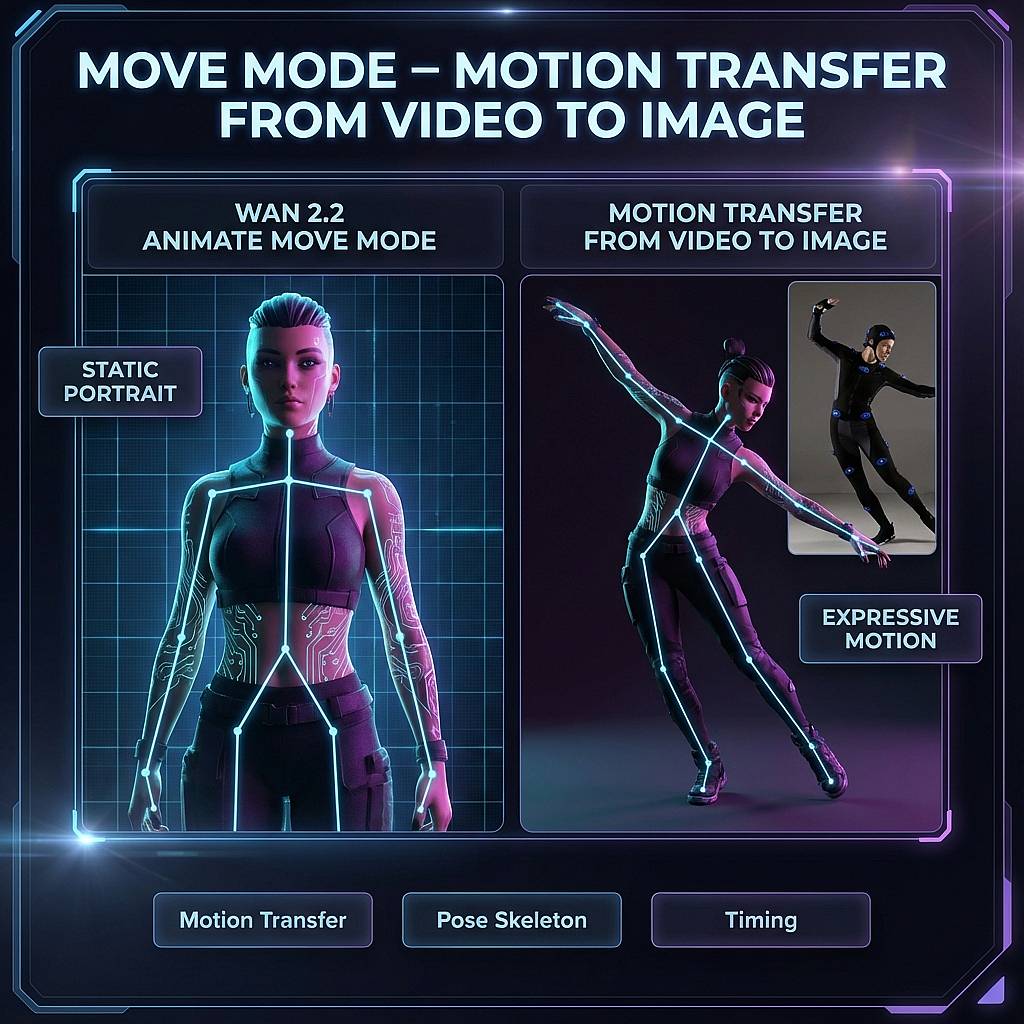

- Charakteranimation – Im Move-Modus nimmt WAN 2.2 Animate ein statisches Charakterbild und eine Bewegungsreferenz und erzeugt ein neues Video, in dem dein Charakter dieselben Gesten, Kopfdrehungen und den Rhythmus ausführt.

- Charakteraustausch – Im Replace-Modus behält das Modell Hintergrund und Kamera des Originalvideos bei, tauscht aber den Onscreen-Charakter gegen den deiner Referenz aus. Geeignet für Face Swaps, Avatar-Platzierungen und Creator-Stand-ins.

- Einheitliches Modell – Move und Replace gehören zum selben Wan-Animate 2.2 Modell, liefern konsistentes Verhalten für Animation und Austausch und vereinfachen Prompt-, Safety- und Auflösungs-Settings.

- Kompatibel mit bestehenden Tools – WAN 2.2 Animate steckt hinter vielen bekannten Workflows: ComfyUI-Graphen, Hugging Face Spaces, Online-WAN-Animate-Demos und lokalen GGUF-Builds. Diese Seite hilft, das alles einfach im Browser-Hub zu nutzen.

Funktionen von WAN 2.2 Animate Move & Replace

Zwei Modi, ein einheitliches WAN-Animate-Modell für Animation und Austausch

WAN 2.2 Animate nutzt ein Video-zu-Video-Modell, um Bewegung, Pose und Ausdrücke aus einem Referenzvideo zu replizieren. Move und Replace geben dir zwei Wege: ein statisches Bild animieren oder einen Charakter in bestehendes Footage einsetzen.

Funktionen von WAN 2.2 Animate Move & Replace

WAN 2.2 Animate nutzt ein Video-zu-Video-Modell, um Bewegung, Pose und Ausdrücke aus einem Referenzvideo zu replizieren. Move und Replace geben dir zwei Wege: ein statisches Bild animieren oder einen Charakter in bestehendes Footage einsetzen.

Warum Creator WanX Ai Hub für WAN 2.2 Animate wählen

Von schnellen Tests zu wiederholbaren Move- & Replace-Workflows

Führe WAN 2.2 Animate Move und Replace an einem Ort aus, vergleiche Outputs und behalte die Presets, die wirklich in deinen Projekten landen.

Ein Ort für WAN-Animate-Traffic

Keine Sprünge mehr zwischen Demos und Teil-Workflows. WanX Ai Hub bündelt WAN 2.2 Animate Move & Replace, WAN 2.5 Video und andere WAN 2.2 Routen in einem Workspace für KI-Video-Creator.

Move & Replace nebeneinander

Nutze dasselbe Bild und denselben Driver-Clip, um Move- und Replace-Versionen zu erzeugen, und behalte, was den Shot besser verkauft – Motion-Transfer-Animation, Character Swap oder beides.

Bibliothek für Prompts & Workflows

Speichere WAN 2.2 Animate Prompts, Dauern und Seitenverhältnisse als Presets. Starte mit kuratierten Move-/Replace-Templates für Talking Heads, Dance-Loops, UGC-Ads und VTuber-Intros statt jedes Mal ein leeres Formular auszufüllen.

Brücke zwischen Online-Tests und lokalen Pipelines

Feile deine Einstellungen hier, bevor du in ComfyUI-Graphen, GGUF-Downloads oder eigene WAN 2.2 Animate Server investierst. Wenn der Workflow hier passt, spiegle die Parameter in deinen Stack.

Credit-Modell für Creator

Du brauchst keinen eigenen 2.2 Animate Cluster. Starte mit Testguthaben, finde heraus, wie lang deine Move-/Replace-Clips wirklich sein müssen, und skaliere mit planbarer Pay-per-Run-Preisgestaltung.

Auf echte Projekte, nicht nur Benchmarks gebaut

UI, Beispiele und Docs fokussieren echte Creator-Jobs: YouTube-Intros, Kunden-Ads, VTuber-Avatare und Social-Experimente, nicht nur Benchmarks und Research-Samples.

Teste Move & Replace mit Testguthaben, dann pay-per-run

Starte WAN 2.2 Animate Move und Replace mit Testguthaben, um Motion-Templates, Clip-Längen und Swap-Qualität zu validieren. Wenn der Workflow sitzt, lade Credits auf und zahle pro erfolgreichem Video-zu-Video-Job.

Erstelle deinen ersten WAN 2.2 Animate Move- oder Replace-Clip

Lade ein Charakterbild und ein Referenzvideo hoch, wähle Move für Motion Transfer oder Replace für Character Swap und erzeuge deinen ersten WAN 2.2 Animate Clip. Nutze Presets, um die Settings zu behalten, die für deinen Kanal, Kunden oder Kampagnen funktionieren.

WAN 2.2 Animate Move & Replace FAQ

Schlüsselfragen zu Motion Transfer und Charakterersatz

WAN 2.2 Animate auf einen Blick

Praktische Kennzahlen für echte Move- & Replace-Workflows

Wisse, was WAN 2.2 Animate Move & Replace leisten kann, bevor du Credits verbrauchst.

Video-zu-Video-Charakteranimation und -ersatz in 720p

Unterstützt Motion Transfer und Face/Character Swap aus einem einzigen Driver-Clip

Optimierte Presets für kurze Hooks, mittlere Edits und längere Character-Performance-Tests

Stimmen von Creatorn zu WAN 2.2 Animate Move & Replace

Early Adopters, die WAN 2.2 Animate für Charakteranimation, Face Swap und KI-Video-Workflows nutzen.

Ivy Chen

VTuber & StreamerinMove hat meinem Avatar endlich natürliche Bewegung gegeben, ganz ohne volles Mocap-Setup. Ich prototype Gesten hier und nehme die besten Clips in meine Stream-Overlays.

Daniel Foster

Video Editor für AdsReplace ist der erste KI-Face-Swap, der das Kundenreview überlebt hat. Hintergrund, Licht und Timing bleiben erhalten, niemand meckert mehr, dass es fake aussieht.

Ivy Chen

VTuber & StreamerinMove hat meinem Avatar endlich natürliche Bewegung gegeben, ganz ohne volles Mocap-Setup. Ich prototype Gesten hier und nehme die besten Clips in meine Stream-Overlays.

Daniel Foster

Video Editor für AdsReplace ist der erste KI-Face-Swap, der das Kundenreview überlebt hat. Hintergrund, Licht und Timing bleiben erhalten, niemand meckert mehr, dass es fake aussieht.

Ivy Chen

VTuber & StreamerinMove hat meinem Avatar endlich natürliche Bewegung gegeben, ganz ohne volles Mocap-Setup. Ich prototype Gesten hier und nehme die besten Clips in meine Stream-Overlays.

Daniel Foster

Video Editor für AdsReplace ist der erste KI-Face-Swap, der das Kundenreview überlebt hat. Hintergrund, Licht und Timing bleiben erhalten, niemand meckert mehr, dass es fake aussieht.

Ivy Chen

VTuber & StreamerinMove hat meinem Avatar endlich natürliche Bewegung gegeben, ganz ohne volles Mocap-Setup. Ich prototype Gesten hier und nehme die besten Clips in meine Stream-Overlays.

Daniel Foster

Video Editor für AdsReplace ist der erste KI-Face-Swap, der das Kundenreview überlebt hat. Hintergrund, Licht und Timing bleiben erhalten, niemand meckert mehr, dass es fake aussieht.

Newsletter

Werde Teil der Community

Abonniere unseren Newsletter für die neuesten News und Updates